آیا به برنامه دوستیابی پیوسته اید؟ یا به دنبال عشق در جای دیگری هستید؟ کلاهبرداران می توانند با استفاده از هوش مصنوعی از شما سوء استفاده کنند. در اینجا چگونگی آن است.

اپلیکیشنهای دوستیابی آنلاین همیشه بستری برای کلاهبرداریهای عاشقانه بودهاند. مجرمان سایبری برای سرقت پول، اطلاعات شخصی و عکس های صریح فراتر از آن عمل می کنند. پروفایل های جعلی آنها را همه جا خواهید یافت.

و با گسترش ابزارهای هوش مصنوعی مولد، اجرای کلاهبرداری های عاشقانه حتی ساده تر می شود. آنها موانع ورود را کاهش می دهند. در اینجا هفت روش متداول که کلاهبرداران عاشقانه از هوش مصنوعی سوء استفاده میکنند، آورده شده است – به علاوه اینکه چگونه میتوانید از خود محافظت کنید.

1. ارسال انبوه ایمیل های تولید شده توسط هوش مصنوعی

فیلتر کردن ایمیل های اسپم سخت تر می شود. کلاهبرداران عاشقانه از ابزارهای هوش مصنوعی برای نوشتن پیام های گمراه کننده و قانع کننده و ایجاد چندین حساب در عرض چند ساعت سوء استفاده می کنند. آنها تقریباً بلافاصله به صدها نفر نزدیک می شوند.

پیامهای هرزنامه تولید شده توسط هوش مصنوعی را در پلتفرمهای مختلف مشاهده خواهید کرد، نه فقط صندوق ورودی ایمیل خود. به عنوان مثال، کلاهبرداری اعداد اشتباه را در نظر بگیرید. کلاهبرداران به طور دسته جمعی سلفی های زیبا یا عکس های پیشنهادی ارسال می کنند. و اگر کسی پاسخ دهد، آن را به عنوان یک اشتباه بی گناه نشان می دهد.

هنگامی که شخصی در خط است، به پلتفرم پیام رسانی دیگری (به عنوان مثال، واتس اپ یا تلگرام) منتقل می شود. اکثر طرح ها برای هفته ها اجرا می شوند. کلاهبرداران به تدریج قبل از اینکه از هدفها بخواهند به طرحهای سرمایهگذاری بپیوندند، صورتحسابهایشان را بر عهده بگیرند یا هزینه سفر را بپردازند، اعتماد ایجاد میکنند.

با اجتناب کامل از پیام های هرزنامه ایمن بمانید. تعامل خود را با غریبه ها، صرف نظر از ظاهر یا آنچه که ارائه می دهند، محدود کنید.

2. پاسخگویی سریع به مکالمات بیشتر

ربات ها مانند آتش سوزی آنلاین در حال گسترش هستند. Imperva گزارش میدهد که رباتهای بد 30 درصد از ترافیک وب خودکار را در سال 2022 تشکیل میدهند. در عرض چند ثانیه پس از تند کشیدن در مسابقات Tinder، یکی از آنها را خواهید یافت.

یکی از دلایل این افزایش ناگهانی در ربات ها، گسترش ابزارهای مولد هوش مصنوعی است. آنها ربات ها را به صورت عمده تولید می کنند. فقط درخواست مناسب را وارد کنید، و ابزار شما یک قطعه کد کامل و کارآمد را برای تولید ربات ارائه می دهد.

بدانید چه زمانی با یک ربات صحبت می کنید. اگرچه هوش مصنوعی از لحن طبیعی و مکالمه ای استفاده می کند، اما گفتگوی آن هنوز یکنواخت و ناخوشایند به نظر می رسد. از این گذشته، چت بات ها فقط از الگوهایی پیروی می کنند. ممکن است پاسخ های مشابهی به سوالات، اظهارات و درخواست های مختلف ایجاد کند.

3. ایجاد چندین هویت از تصاویر دزدیده شده

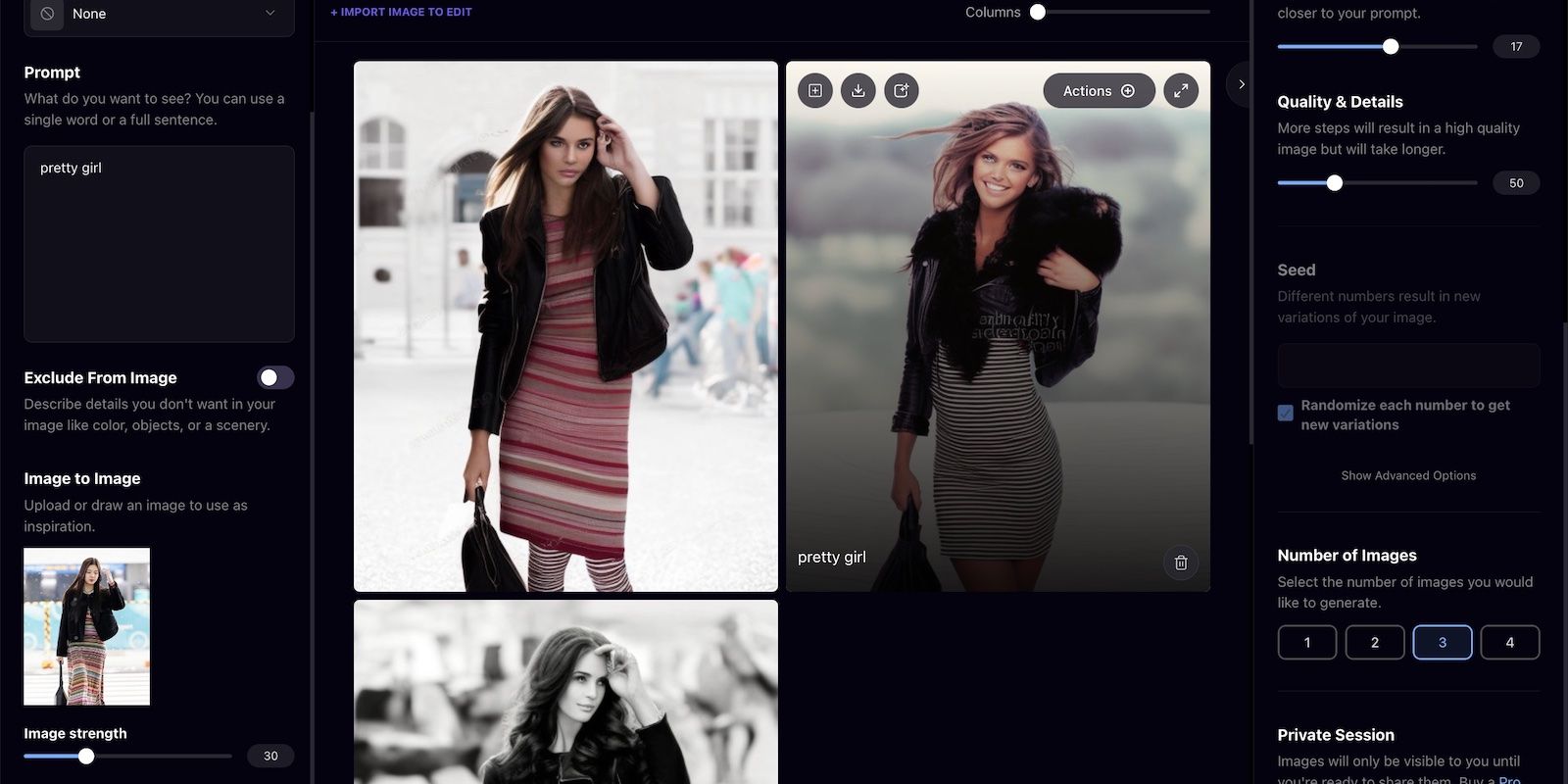

مولدهای هنری هوش مصنوعی تصاویر را دستکاری می کنند. مثال زیر را در نظر بگیرید. ما به Playground AI یک عکس صریح از یک خواننده مشهور را دادیم – این پلتفرم در عرض چند ثانیه سه تغییر ایجاد کرد.

بله ایراداتی دارند. اما توجه داشته باشید که ما از یک ابزار رایگان استفاده کردیم که یک مدل متن به تصویر قدیمی را اجرا میکرد. کلاهبرداران با تکرارهای پیچیده خروجی واقعی تری تولید می کنند. آنها می توانند به سرعت صدها عکس سفارشی شده و دستکاری شده را تنها از چند نمونه ارائه دهند.

متأسفانه تشخیص تصاویر هوش مصنوعی دشوار است. بهترین گزینه این است که یک جستجوی عکس معکوس انجام دهید و نتایج مرتبط را غربال کنید.

4. ساختن پروفایل هایی با ظاهری فریبنده و معتبر

ربات ها به طور دسته جمعی به قربانیان نزدیک می شوند. بنابراین کلاهبرداران عاشقانه که یک طرح هدفمند را ترجیح می دهند، فقط یک یا دو پروفایل با ظاهری معتبر ایجاد می کنند. آنها از هوش مصنوعی استفاده خواهند کرد تا قانع کننده به نظر برسند. ابزارهای مولد هوش مصنوعی میتوانند توصیفهایی با ظاهری معتبر بسازند که طبیعی و واقعی به نظر برسند. گرامر بد دیگر مشکلی نخواهد بود.

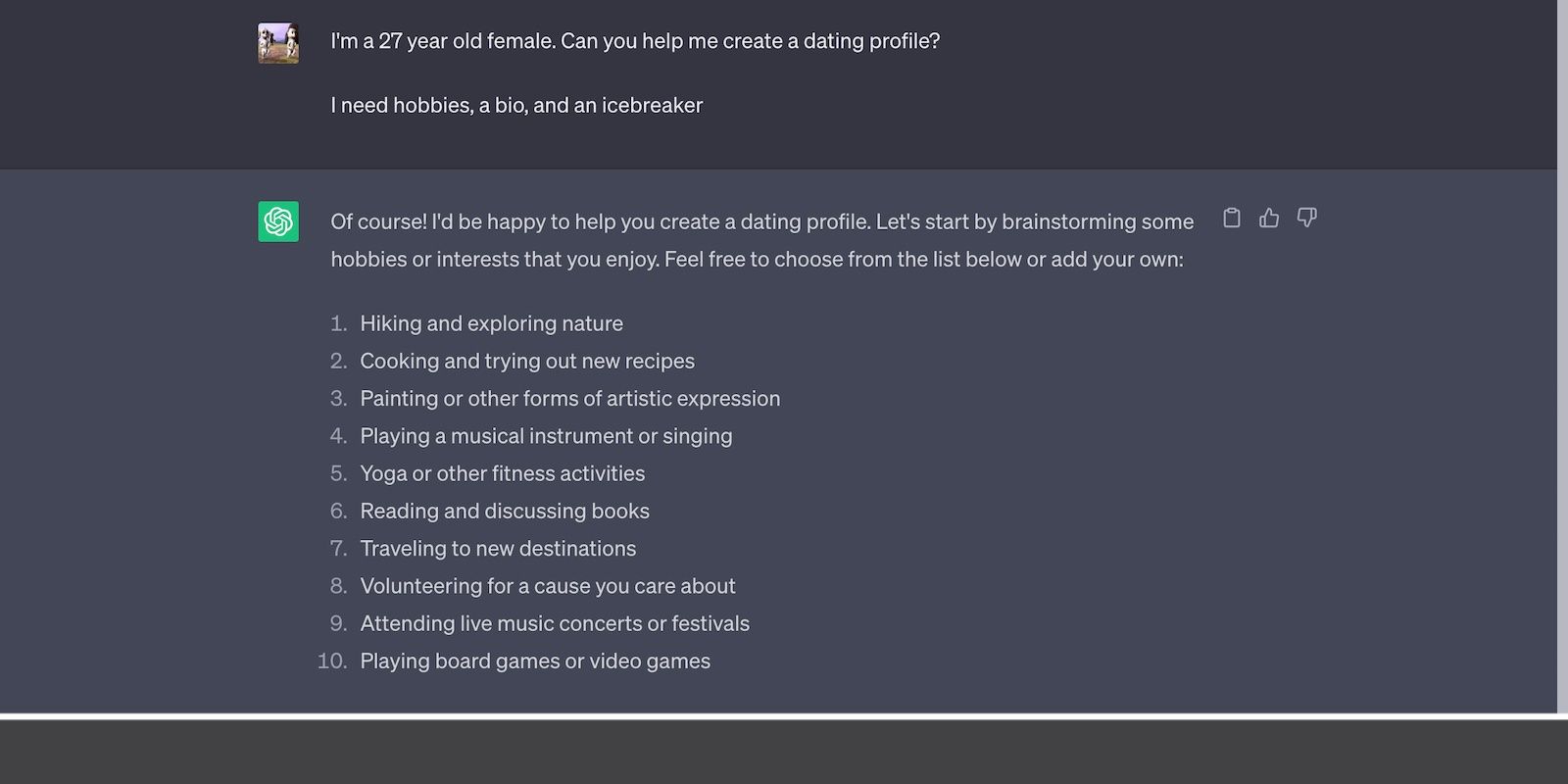

در اینجا ChatGPT برخی از سرگرمیها را برای فهرست کردن در نمایه دوستیابی پیشنهاد میکند.

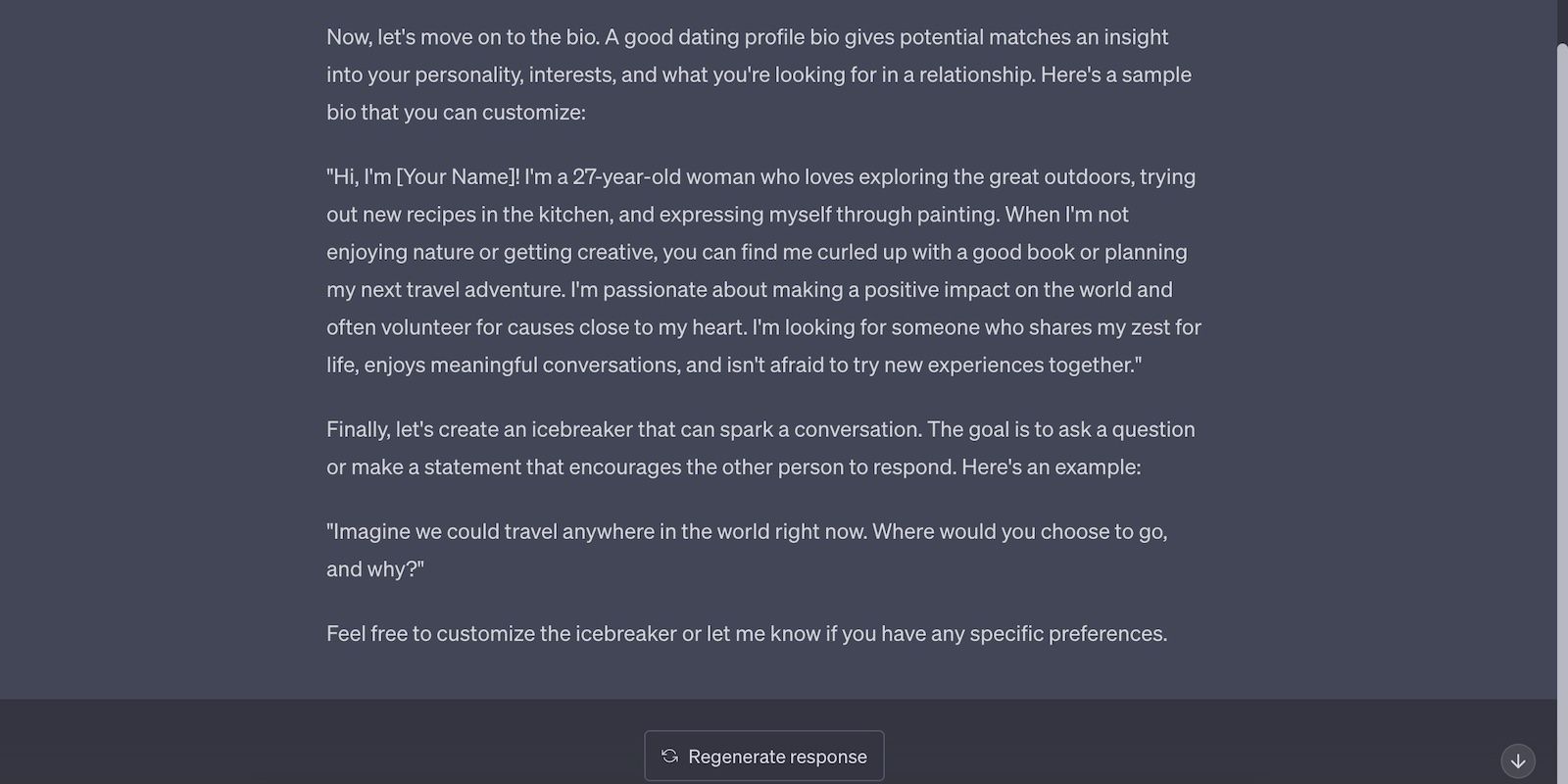

و در اینجا ChatGPT است که یک بیوگرافی کامل برای پروفایل دوستیابی شما می نویسد.

از آنجایی که این فرآیند زمان زیادی را صرف می کند، به بازده بزرگتری نیز نیاز دارد. بنابراین، کلاهبرداران تمایل به درخواست بیشتر دارند. هنگامی که اعتماد شما را به دست آوردند، برای «مشکلات» مختلف، مانند صورتحسابهای بیمارستان، پرداختهای وام، یا هزینههای تحصیل، کمک میخواهند. حتی برخی ادعا می کنند که اگر بلیط آنها را به دوش بکشید، از شما دیدن می کنند.

این مجرمان سایبری در دستکاری قربانیان مهارت دارند. بهترین تاکتیک این است که از همان ابتدا با آنها درگیر نشوید. اجازه نده چیزی بگویند در غیر این صورت، ممکن است به تدریج گرفتار روش های فریب کاری و گاز سوزی آنها شوید.

5. بهره برداری از فناوری Deepfake برای اخاذی جنسی

هوش مصنوعی ابزارهای دیپ فیک پیشرفته را با سرعت هشدار دهنده ای سریع می کند. فناوریهای جدید عیوب جزئی را در ویدیوهای دیپفیک کاهش میدهند، مانند چشمک زدن غیرطبیعی، رنگ پوست ناهموار، صدای مخدوش، و عناصر ناسازگار.

متأسفانه، این خطاها به عنوان پرچم قرمز نیز عمل می کنند. فعال کردن کاربران برای حذف آنها، تمایز بین ویدیوهای قانونی و دیپفیک را سختتر میکند.

بلومبرگ نشان میدهد که چگونه هر کسی با دانش پایه فناوری میتواند صدا و تصاویر خود را برای تکرار دیگران دستکاری کند.

به غیر از ایجاد پروفایل های دوستیابی واقعی، کلاهبرداران از ابزارهای دیپ فیک برای اخاذی جنسی سوء استفاده می کنند. آنها عکس ها و فیلم های عمومی را با پورنوگرافی ترکیب می کنند. پس از دستکاری محتوای غیرقانونی، آنها از قربانیان باجگیری میکنند و تقاضای پول، دادههای شخصی یا لطف جنسی میکنند.

اگر مورد هدف قرار گرفتید تسلیم نشوید. با شماره 1-800-CALL-FBI تماس بگیرید، راهنمایی FBI بفرستید، یا اگر در این موقعیت قرار گرفتید، به دفتر محلی FBI مراجعه کنید.

6. یکپارچه سازی مدل های هوش مصنوعی با سیستم های هک Brute-Force

در حالی که مدلهای زبان منبع باز از برخی پیشرفتهای هوش مصنوعی پشتیبانی میکنند، آنها نیز مستعد بهرهبرداری هستند. جنایتکاران از هر چیزی سوء استفاده خواهند کرد. شما نمی توانید انتظار داشته باشید که آنها الگوریتم مدل های زبان بسیار پیچیده مانند LLaMA و OpenAssistant را نادیده بگیرند.

در کلاهبرداری های عاشقانه، هکرها اغلب مدل های زبان را با شکستن رمز عبور ادغام می کنند. قابلیتهای NLP و یادگیری ماشینی هوش مصنوعی، سیستمهای هک با نیروی brute-force را قادر میسازد تا ترکیبهای رمز عبور را سریع و کارآمد تولید کنند. آنها حتی می توانند پیش بینی های آگاهانه ای انجام دهند اگر زمینه کافی فراهم شود.

شما هیچ کنترلی بر کاری که کلاهبرداران انجام می دهند ندارید. برای محافظت از حسابهای خود، مطمئن شوید که یک رمز عبور واقعاً امن شامل کاراکترهای خاص، ترکیبهای الفبایی و 14+ کاراکتر ایجاد کردهاید.

7. تقلید از افراد واقعی با شبیه سازی صدا

مولدهای صوتی هوش مصنوعی به عنوان یک اسباب بازی جالب شروع شدند. کاربران نمونه آهنگ های هنرمندان مورد علاقه خود را به کاور یا حتی آهنگ های جدید تبدیل می کنند. Heart on My Sleeve را به عنوان مثال در نظر بگیرید. کاربر TikTok Ghostwriter977 یک آهنگ فوقالعاده واقعی با تقلید از Drake و The Weeknd ساخت، اگرچه هیچ کدام از هنرمندان آن را نخواندند.

با وجود جوک ها و میم های اطراف آن، سنتز گفتار بسیار خطرناک است. مجرمان را قادر می سازد تا حملات پیچیده ای را انجام دهند. به عنوان مثال، کلاهبرداران عاشقانه از ابزارهای شبیه سازی صوتی برای تماس با اهداف و ایجاد ضبط های فریبنده سوء استفاده می کنند. قربانیانی که با سنتز گفتار آشنا نیستند، متوجه هیچ چیز غیرعادی نخواهند شد.

با مطالعه نحوه صدای خروجی های ترکیب شده، از خود در برابر کلاهبرداری های شبیه سازی صوتی هوش مصنوعی محافظت کنید. این ژنراتورها را کاوش کنید. آنها صرفاً کلون های تقریباً یکسانی ایجاد می کنند – شما هنوز هم برخی از نقص ها و ناسازگاری ها را خواهید دید.

از خود در برابر کلاهبرداران آشنایی با هوش مصنوعی محافظت کنید

با پیشرفت ابزارهای هوش مصنوعی مولد، کلاهبرداران عاشقانه راههای جدیدی را برای بهرهبرداری از آنها توسعه خواهند داد. توسعه دهندگان نمی توانند جلوی این جنایتکاران را بگیرند. در مبارزه با جرایم سایبری به جای اینکه فقط به کارکرد محدودیت های امنیتی اعتماد داشته باشید، نقشی فعال داشته باشید. هنوز هم می توانید از برنامه های دوستیابی استفاده کنید. اما مطمئن شوید که قبل از درگیر شدن با فرد طرف دیگر صفحه، او را می شناسید.

و مراقب سایر طرحهای به کمک هوش مصنوعی باشید. علاوه بر کلاهبرداریهای عاشقانه، مجرمان از هوش مصنوعی برای سرقت هویت، اخاذی سایبری، باجگیری، حملات باجافزاری و هکهای بیرحمانه استفاده میکنند. مبارزه با این تهدیدات را نیز یاد بگیرید.