هوش مصنوعی مولد همچنان موج می زند، به خصوص که پلتفرم های رسانه های اجتماعی در تلاش برای پیاده سازی این فناوری هستند. با این حال، هوش مصنوعی مولد با برخی از اشکالات عمده برای کاربران رسانه های اجتماعی همراه بوده است. در اینجا به تعدادی از آنها اشاره می کنیم …

خلاصه عناوین

- سیل از AI Slop

- از دست دادن حتی بیشتر اصالت

- اشتباهات رسانه های اجتماعی توسط هوش مصنوعی

- تحقق نظریه اینترنت مرده

- مردم باید راه هایی برای محافظت از محتوای خود در برابر خراشیدن هوش مصنوعی بیابند

هوش مصنوعی مولد همچنان موج می زند، به خصوص که پلتفرم های رسانه های اجتماعی در تلاش برای پیاده سازی این فناوری هستند. با این حال، هوش مصنوعی مولد با برخی از اشکالات عمده برای کاربران رسانه های اجتماعی همراه بوده است. در اینجا به تعدادی از آنها اشاره می کنیم …

1 سیلی از AI Slop

اگر از کاربران مکرر پلتفرم هایی مانند فیس بوک هستید، احتمالاً با شیب هوش مصنوعی مواجه شده اید. AI slop خروجی ناخواسته هوش مصنوعی مولد، از جمله آثار هنری سورئال و دستور العمل های مزخرف است. در حال حاضر حتی یک حساب X اختصاص داده شده به AI slop در فیس بوک وجود دارد.

اغلب AI slop از صفحات هرزنامه ای که به دنبال ویروسی شدن هستند ظاهر می شود. و از آنجایی که فیسبوک محتوای ویروسی را توصیه میکند، این بدان معناست که ممکن است در فید خود بیش از حد معمول مزخرفتر شوید. هوش مصنوعی مولد تولید این نوع پستهای هرزنامه را آسانتر از همیشه کرده است و در نتیجه محتوای واقعی در پلتفرمهای رسانههای اجتماعی هجوم مییابد.

2 از دست دادن حتی بیشتر اصالت

![]()

رسانه های اجتماعی دقیقاً از نظر اعتبار شناخته شده نیستند. اغلب اینفلوئنسرها اجمالی از زندگی خود را نشان می دهند که عمدتاً با هدف ارائه تصویری از کمال یا فروش محصولی است که برای تبلیغ آنها پول دریافت کرده اند.

اما هوش مصنوعی این عدم اصالت را حتی بیشتر می کند. به گزارش SocialMediaToday، TikTok در حال آزمایش اینفلوئنسرهای مجازی است که به کسب و کارها اجازه می دهد با استفاده از یک آواتار دیجیتالی ایجاد شده برای کاربران تبلیغ کنند. در همین حال اینستاگرام در حال آزمایش قابلیتی است که به اینفلوئنسرها اجازه میدهد رباتهای هوش مصنوعی خود را بسازند که در پیامها به طرفداران پاسخ دهند. این آزمایش توسط مارک زاکربرگ مدیر عامل متا در کانال پخش اینستاگرام خود اعلام شد.

این کاهش اعتبار کمی که در رسانههای اجتماعی وجود دارد، تنها به اینفلوئنسرها مربوط نمیشود. هوش مصنوعی برای ایجاد پست های کاربران در شبکه های رسانه های اجتماعی مانند Reddit و X (توئیتر) استفاده می شود. در حالی که رباتهای چت که میتوانند این کار را انجام دهند مدتی است وجود داشتهاند، راهاندازی مدلهای زبان بزرگ تشخیص اینکه چه چیزی واقعی است و چه چیزی نیست را دشوارتر کرده است. هر روزی که من از Reddit استفاده می کنم ناگزیر شامل کاربرانی می شود که دیگران را به استفاده از هوش مصنوعی برای نوشتن یک پست یا داستان متهم می کنند.

3 اشتباه رسانه های اجتماعی توسط هوش مصنوعی

پلتفرمهای هوش مصنوعی شرکتهای رسانههای اجتماعی هنوز در حال پیشرفت هستند، به این معنی که هنوز اشتباه میکنند. برخی از این اشتباهات به اطلاعات نادرست یا کاهش اعتماد کاربران به پلتفرم کمک می کند.

به عنوان مثال، هوش مصنوعی متا به پستی در یک گروه فیس بوک پاسخ داد که ادعا می کرد والدینی با یک فرزند “2e” (دوبار استثنایی) در برنامه ای برای دانش آموزان تیزهوش و با استعداد ثبت نام کرده اند، همانطور که توسط اسکای نیوز گزارش شده است. خوشبختانه از آنجایی که پاسخ های هوش مصنوعی متا به وضوح در فیس بوک مشخص شده است، کاربران قادر به تشخیص واقعی نبودن پاسخ بودند. اما وقتی ابزارهای هوش مصنوعی مانند Meta AI خود را وارد مکالماتی می کنند که جایی در آن ندارند، قابل اعتماد بودن را زیر سوال می برد.

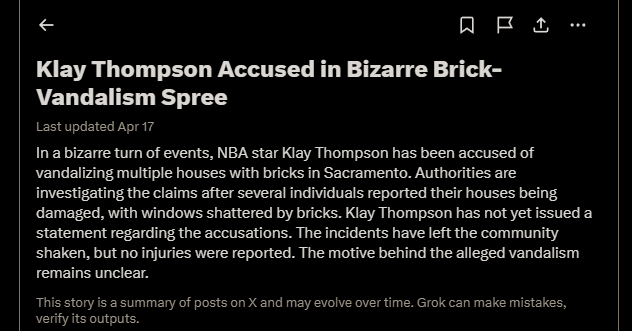

در همین حال، Grok AI (ربات چت هوش مصنوعی X)، به دلیل تولید اطلاعات نادرست فراخوانده شده است. یکی از این موارد شامل متهم کردن بازیکن NBA، کلای تامپسون به خرابکاری خانهها بود، پس از آن که هوش مصنوعی این عامیانه بسکتبال را به اشتباه تعبیر کرد که ضرباتی را که به داخل سبد نمیروند را «آجر» مینامد.

در حالی که برخی از توهمات هوش مصنوعی خنده دار هستند، سایر اطلاعات نادرست نگران کننده تر است و منجر به عواقب دنیای واقعی می شود.

4 تحقق نظریه اینترنت مرده

نظریه اینترنت مرده این ایده است که اکثریت قریب به اتفاق محتوا در اینترنت توسط ربات ها تولید می شود. در حالی که در گذشته به راحتی می توان با آن تمسخر کرد، اما به نظر می رسد بیشتر و بیشتر قابل قبول باشد زیرا ما مملو از هرزنامه ها و پاسخ های هوش مصنوعی در سیستم عامل های رسانه های اجتماعی هستیم.

این واقعیت که شرکت های رسانه های اجتماعی نیز ربات ها را به عنوان کاربران ادغام می کنند، این ایده را واقعی تر از قبل می کند. حتی منجر به راهاندازی هوش مصنوعی پروانهها شد، یک پلتفرم رسانه اجتماعی که در آن برخی از کاربران در واقع فقط رباتهای هوش مصنوعی هستند. در حالی که رباتها میتوانند در رسانههای اجتماعی مفید باشند، ژست گرفتن آنها مانند سایر کاربران برای من جذابیتی ندارد.

از نظر تجربه کاربر روزانه، هوش مصنوعی مولد تقلید کاربران واقعی را برای رباتهای هرزنامه آسانتر کرده است. اخیراً یک پست در X منتشر کردم تا یک اثر هنری را سفارش دهم و صندوق پستی من مملو از پاسخ های ربات ها بود. گفتن کاربران واقعی از ربات ها سخت تر می شود.

5 نفر باید راه هایی برای محافظت از محتوای خود در برابر خراشیدن هوش مصنوعی بیابند

کاربران در حال یافتن راههای مختلفی برای محافظت از محتوای خود در برابر استفاده در مجموعه دادههای هوش مصنوعی هستند. اما همیشه به سادگی انصراف نیست. اگر پستهای شما عمومی هستند، احتمالاً قبلاً برای آموزش هوش مصنوعی استفاده شدهاند.

در نتیجه، کاربران برای محافظت از داده های خود راه حل هایی را امتحان می کنند. این شامل تغییر به پروفایل های خصوصی و همچنین مسمومیت داده ها می شود. در حالی که استفاده از Nightshade برای مسموم کردن آثار هنری تأثیری بر مشاهده تصاویر توسط کاربران ندارد، اشکال دیگر مسمومیت داده ها ممکن است بر محتوایی که در رسانه های اجتماعی می بینیم تأثیر بگذارد.

اگر کاربران بیشتری در شبکه های اجتماعی عمومی بیشتری به پروفایل های خصوصی روی بیاورند، پیدا کردن کاربران و محتوایی که دوست دارید سخت تر می شود. و همانطور که هنرمندان از پلتفرم هایی که داده های آموزشی برای هوش مصنوعی مولد ارائه می دهند دور می شوند، افرادی که به سادگی می خواهند کار آنها را تحسین کنند از دست می دهند مگر اینکه به پلتفرم های خاص بروند.

در حالی که برخی از کاربردهای هوش مصنوعی مولد در این پلتفرم ها وجود دارد، برخی افراد استدلال می کنند که ما واقعاً به هوش مصنوعی مولد در رسانه های اجتماعی نیاز نداریم. اما صرف نظر از آنچه ما فکر می کنیم، هوش مصنوعی مولد در حال حاضر رسانه های اجتماعی را به روش های مختلفی تغییر اساسی داده است.