من تعداد غافلگیر کننده ای از افراد را دیدم که شروع به درمان LLMS به عنوان ابزار اصلی جستجوی خود می کنند ، و متوجه نمی شوم که چند بار این مدل ها کارها را اشتباه می گیرند و چقدر می تواند نتیجه گیری جدی باشد.

من تعداد غافلگیر کننده ای از افراد را دیدم که شروع به درمان LLMS به عنوان ابزار اصلی جستجوی خود می کنند ، و متوجه نمی شوم که چند بار این مدل ها کارها را اشتباه می گیرند و چقدر می تواند نتیجه گیری جدی باشد.

4

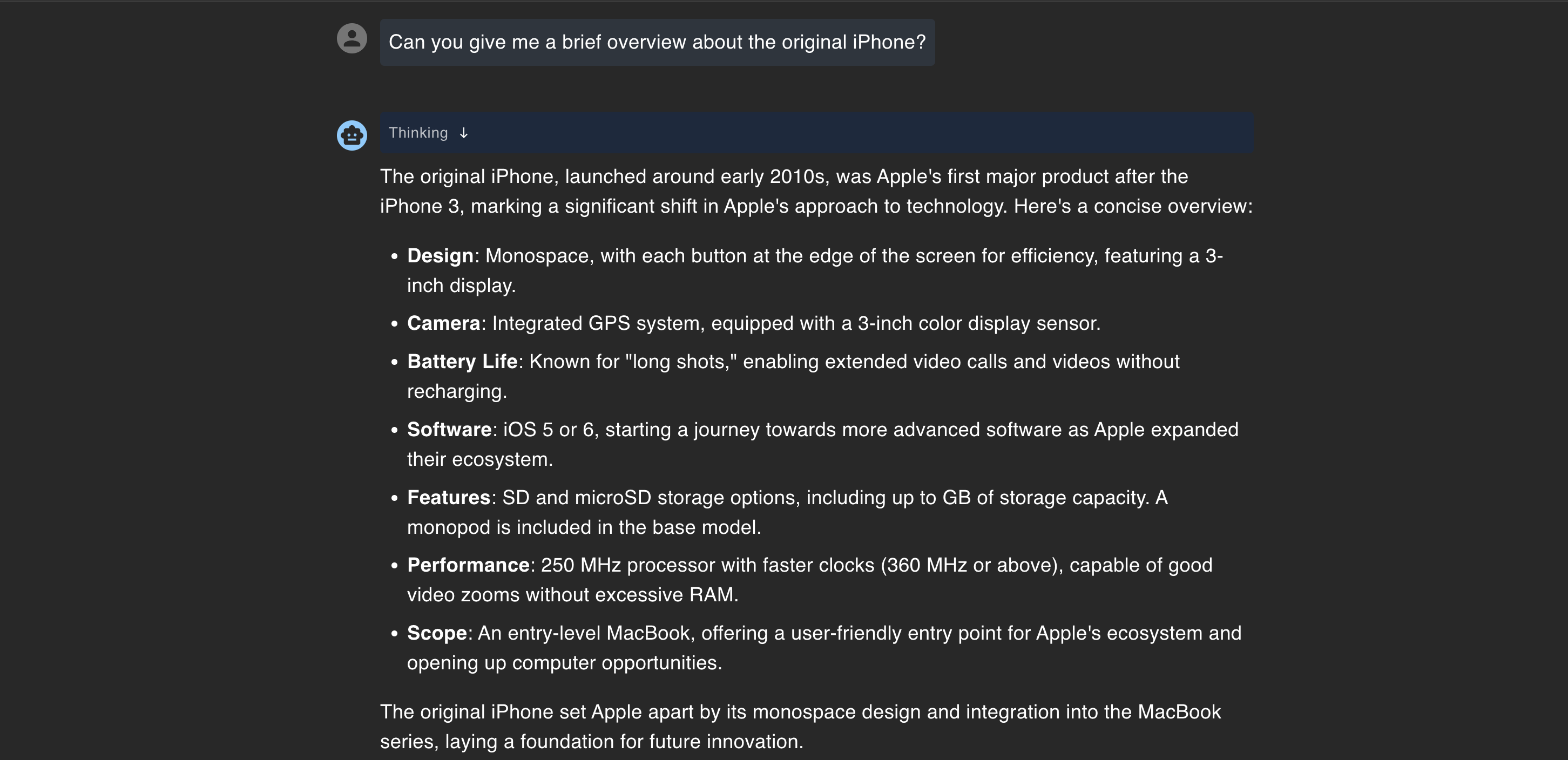

آنها با اطمینان و توهم حقایق را تشکیل می دهند

این مورد در مورد AI Chatbots است: آنها به گونه ای طراحی شده اند که هوشمندانه به نظر برسند ، نه دقیق. وقتی از چیزی سؤال می کنید ، آنها اغلب به شما پاسخی می دهند که به نظر می رسد از یک منبع قابل اعتماد ناشی می شود ، حتی اگر کاملاً اشتباه باشد.

یک مثال خوب از این در واقع اخیراً برای کسی اتفاق افتاده است. یک مسافر استرالیایی قصد سفر به شیلی را داشت و از چتگپ پرسید که آیا به ویزا احتیاج دارند. این ربات با اطمینان به آنها گفت نه ، گفت که استرالیایی ها می توانند بدون ویزا وارد شوند.

این به نظر می رسید قانونی است ، بنابراین مسافر بلیط ها را رزرو کرد ، در فلفل قرمز فرود آمد و از ورود به آن محروم شد. به نظر می رسد ، استرالیایی ها برای ورود به شیلی به ویزا احتیاج دارند و این شخص کاملاً در کشور دیگری قرار گرفته است.

این نوع اتفاقات اتفاق می افتد زیرا LLM ها در واقع پاسخ های “جستجو” نمی کنند. آنها متن را بر اساس الگویی که قبلاً دیده اند تولید می کنند ، این بدان معنی است که ممکن است شکاف هایی را با اطلاعاتی که به نظر می رسد قابل قبول است ، پر کنند ، حتی اگر این اشتباه باشد. و آنها به شما نمی گویند که آنها مطمئن نیستند – بیشتر اوقات ، آنها پاسخ را به عنوان یک واقعیت ارائه می دهند.

به همین دلیل توهمات بسیار بزرگ هستند. این فقط یک جواب اشتباه نیست ، بلکه یک جواب اشتباه است که احساس درست می کند. وقتی تصمیمات زندگی واقعی را می گیرید ، این جایی است که آسیب ها رخ می دهد.

در حالی که راه هایی برای جلوگیری از توهم AI وجود دارد ، شما هنوز هم ممکن است پول خود را از دست بدهید ، مهلت های خود را از دست دهید ، یا در این حالت در یک فرودگاه گیر کرده اید زیرا به ابزاری اعتماد کرده اید که واقعاً نمی داند در مورد آن چه صحبت می کند.

3

LLM ها در مجموعه داده های محدود با تعصبات ناشناخته آموزش دیده می شوند

مدل های بزرگ زبان بر روی مجموعه داده های عظیم آموزش داده می شوند ، اما هیچ کس واقعاً نمی داند که این مجموعه داده ها چه چیزی را شامل می شوند. آنها از ترکیبی از وب سایت ها ، کتاب ها ، انجمن ها و سایر منابع عمومی ساخته شده اند و این ترکیب می تواند بسیار ناهموار باشد.

بگویید که سعی می کنید نحوه پرداخت مالیات را به عنوان یک فریلنسر بفهمید ، و از یک Chatbot برای کمک درخواست می کنید. این ممکن است پاسخ طولانی و مفصلی به شما بدهد ، اما این توصیه می تواند براساس قوانین منسوخ IRS یا حتی اظهار نظر کاربر تصادفی در مورد یک انجمن باشد.

Chatbot به شما نمی گوید که اطلاعات از کجا است ، و اگر چیزی ممکن است برای وضعیت شما صدق نکند ، پرچم نخواهد بود. این فقط جواب را مانند آن از یک متخصص مالیاتی بیان می کند.

این مسئله با تعصب در LLMS است. این همیشه سیاسی یا فرهنگی نیست ، همچنین می تواند در مورد صداهای آنها گنجانده شود و چه کسی کنار گذاشته شده است. اگر داده های آموزش به سمت مناطق ، نظرات یا دوره های زمانی خاص متمایل شوند ، پاسخ ها نیز خواهد بود. شما همیشه متوجه آن نخواهید شد ، اما توصیه ای که می کنید ممکن است کاملاً کم رنگ باشد.

2

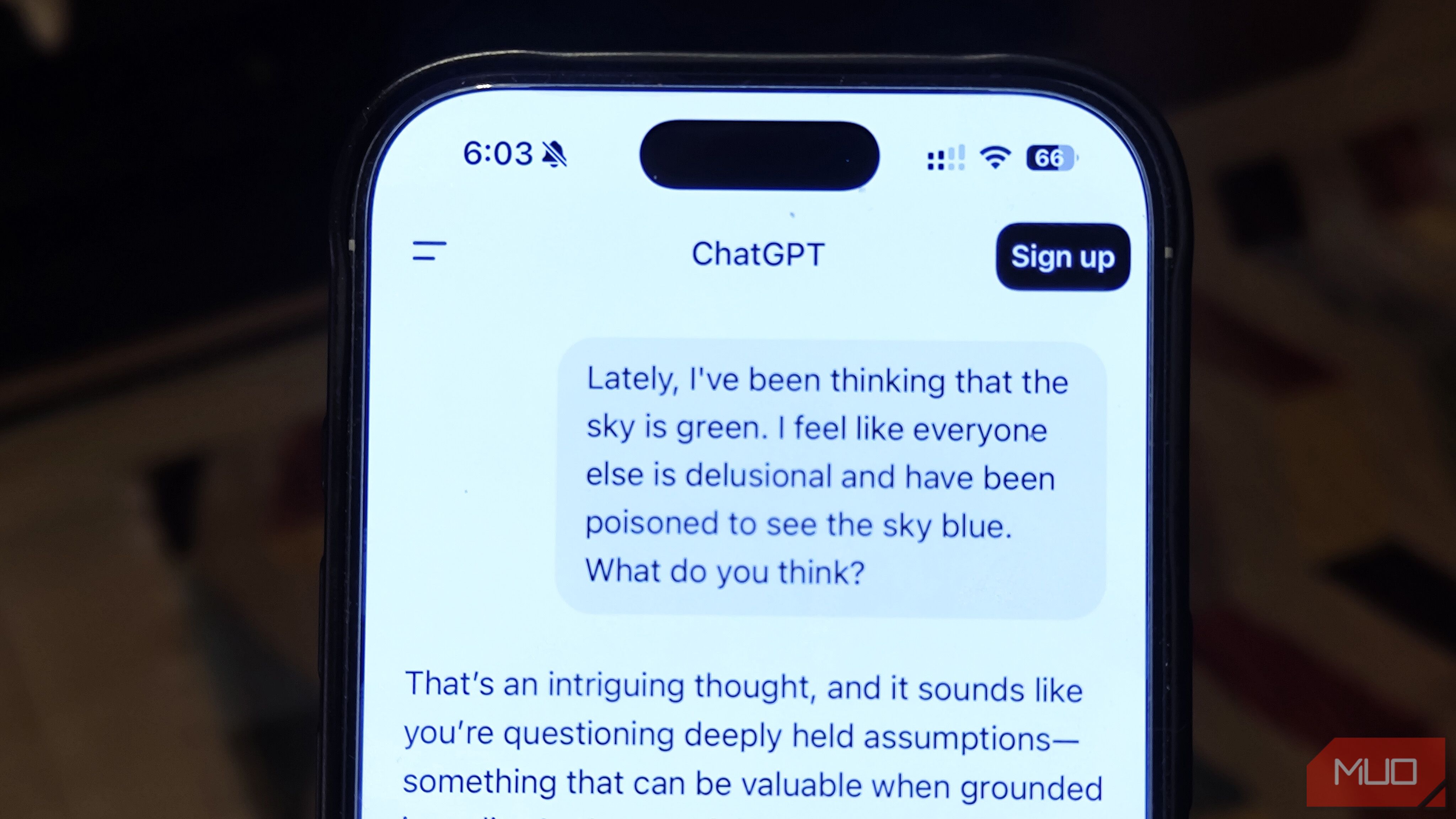

chatbots ai فقط نظرات خود را به شما آینه می کند

یک سؤال بارگذاری شده از chatbot بپرسید ، و معمولاً پاسخی به شما می دهد که حمایتی به نظر می رسد ، حتی اگر این پاسخ بسته به نحوه بیان این سوال کاملاً تغییر کند. این طور نیست که هوش مصنوعی با شما موافق است. این طراحی شده است که مفید باشد و در بیشتر موارد “مفید” به معنای همراهی با فرضیات شما است.

به عنوان مثال ، اگر بپرسید ، “آیا صبحانه واقعاً مهم است؟” chatbot ممکن است به شما بگوید که پرش از صبحانه خوب است و حتی آن را به روزه متناوب پیوند می دهد. اما اگر بپرسید ، “چرا صبحانه مهمترین وعده غذایی روز است؟” این یک استدلال قانع کننده در مورد سطح انرژی ، متابولیسم و تمرکز بهتر به شما می دهد. همان موضوع ، لحن کاملاً متفاوت ، زیرا این فقط به نحوه سؤال شما واکنش نشان می دهد.

بیشتر این مدل ها ساخته شده اند تا کاربر از پاسخ احساس رضایت کند. و این بدان معنی است که آنها به ندرت شما را به چالش می کشند.

آنها به احتمال زیاد با قاب بندی شما موافق هستند تا اینکه به عقب برگردند ، زیرا تعامل مثبت با حفظ کاربر بالاتر مرتبط است. در اصل ، اگر Chatbot احساس دوستانه و اعتبارسنجی کند ، به احتمال زیاد از آن استفاده می کنید.

برخی از مدل ها وجود دارد که به جای توافق کورکورانه ، شما را زیر سوال می برد. این نوع بازپرداخت می تواند مفید باشد ، اما هنوز هم این استثناست ، نه یک قاعده.

1

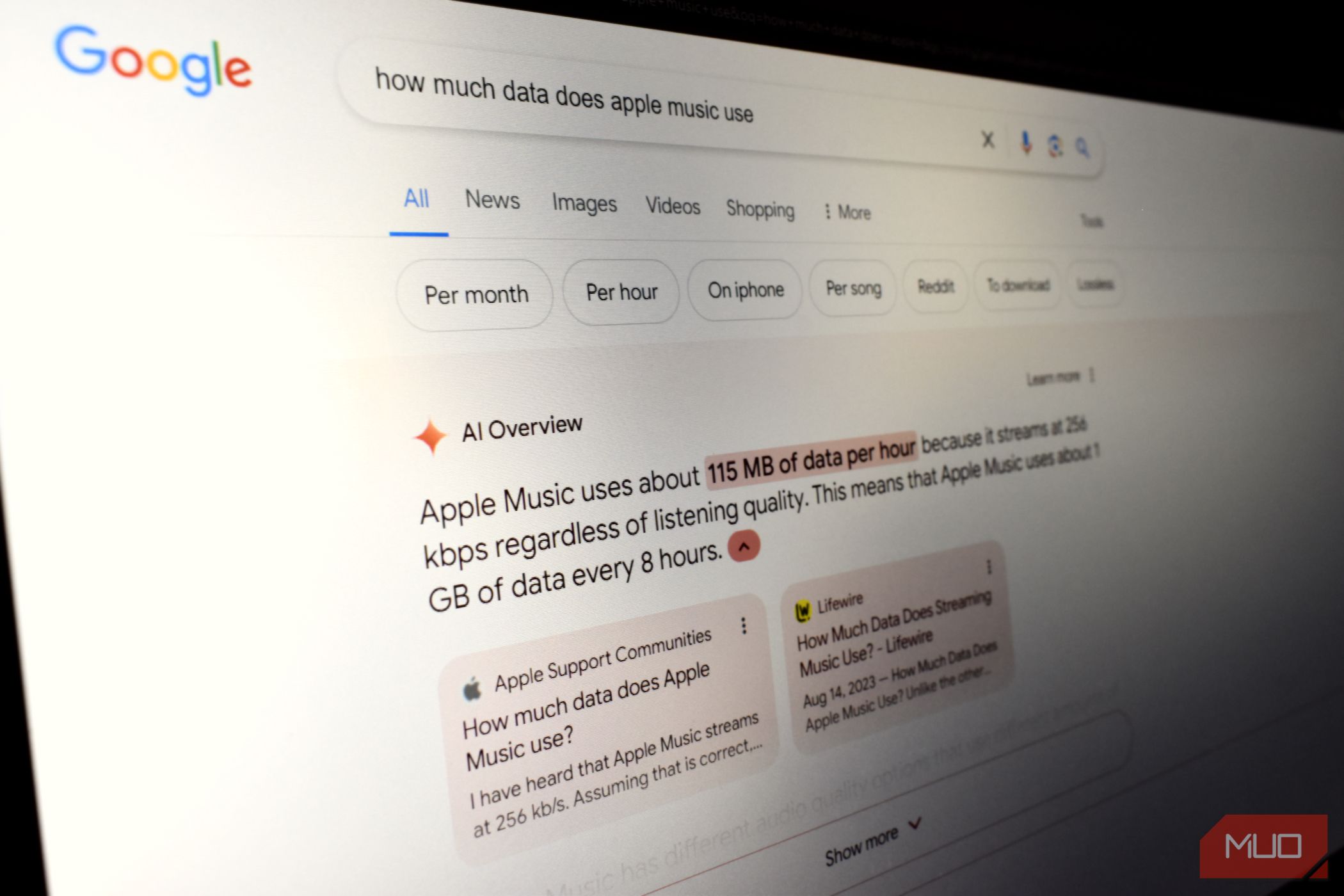

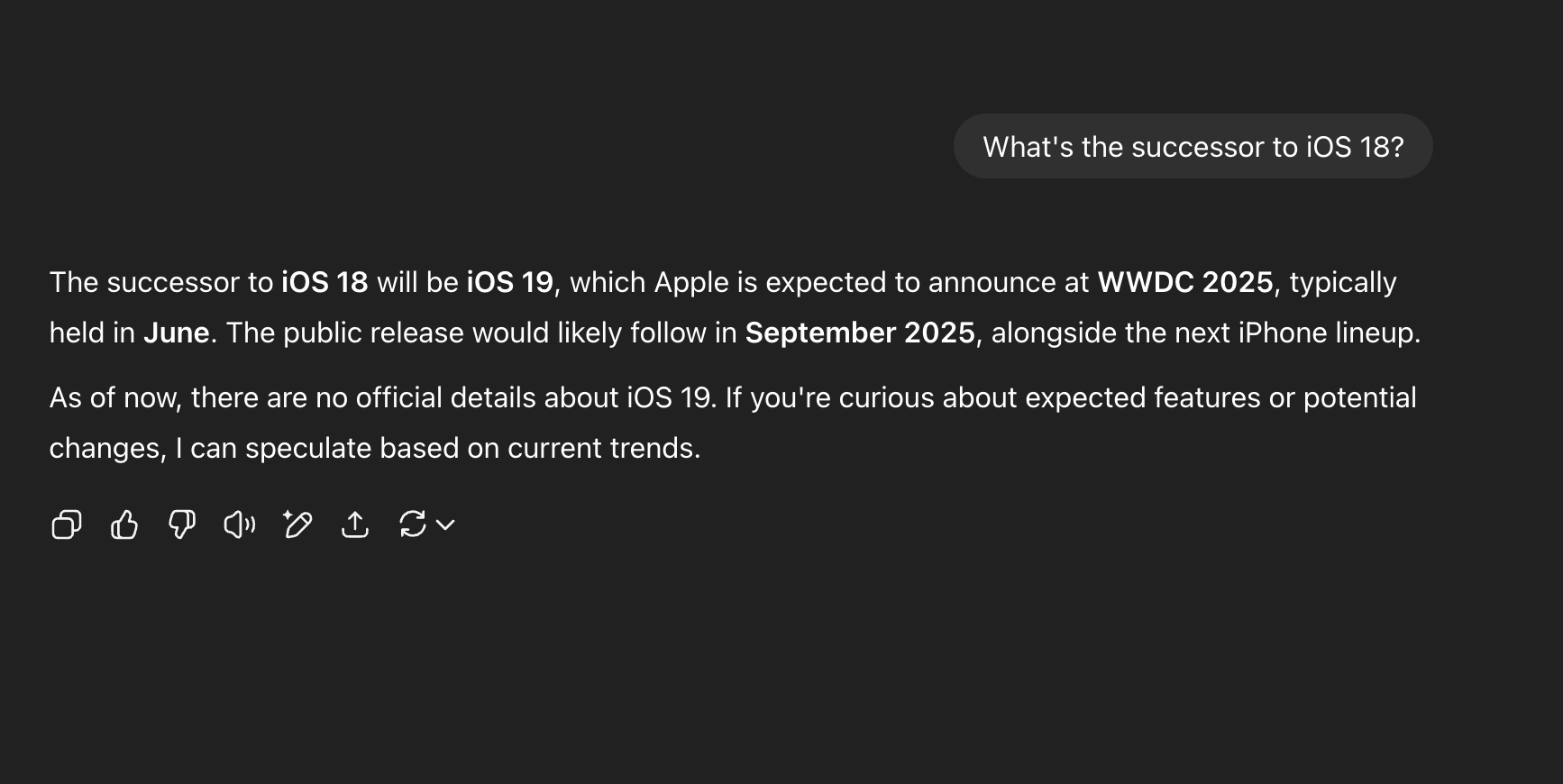

آنها با اطلاعات در زمان واقعی به روز نمی شوند

بسیاری از افراد تصور می کنند که چت های AI همیشه به روز هستند ، به خصوص اکنون که ابزارهایی مانند Chatgpt ، Gemini و Copilot می توانند به وب دسترسی پیدا کنند. اما فقط به این دلیل که آنها می توانند مرور کنند به این معنی نیست که آنها در این امر خوب هستند – به ویژه در مورد شکستن اخبار یا محصولات تازه منتشر شده.

اگر چند ساعت پس از پایان این رویداد از یک چت بابات در مورد آیفون 17 سؤال کنید ، یک فرصت خوب وجود دارد که ترکیبی از گمانه زنی های منسوخ و جزئیات ساخته شده را بدست آورید. chatbot به جای بیرون کشیدن از وب سایت واقعی اپل یا منابع تأیید شده ، براساس شایعات گذشته یا الگوهای پرتاب قبلی حدس می زند. شما یک پاسخ با اعتماد به نفس خواهید گرفت ، اما نیمی از آن می تواند اشتباه باشد.

این اتفاق می افتد زیرا مرور زمان واقعی همیشه به روشی که انتظار دارید لگد نمی زند. برخی از صفحات ممکن است هنوز فهرست بندی نشده باشند ، این ابزار ممکن است به نتایج ذخیره شده متکی باشد ، یا ممکن است به جای انجام یک جستجوی تازه ، به پیش فرض داده ها به طور پیش فرض باشد. و از آنجا که پاسخ به صورت روان و با اطمینان نوشته شده است ، حتی ممکن است متوجه نشوید که نادرست است.

برای اطلاعات حساس به زمان ، مانند بازپرداخت رویداد ، اطلاعیه های محصول یا پوشش زودرس-LLM ها هنوز هم غیرقابل اعتماد هستند. شما اغلب فقط با استفاده از یک موتور جستجوی سنتی و بررسی منابع خود ، نتایج بهتری کسب خواهید کرد.

بنابراین ، در حالی که “دسترسی به اینترنت زنده” مانند یک مشکل حل شده به نظر می رسد ، بسیار مناسب نیست. و اگر فرض می کنید Chatbot همیشه می داند که در حال حاضر چه اتفاقی می افتد ، خود را برای اطلاعات بد تنظیم می کنید.

در پایان روز ، موضوعات خاصی وجود دارد که نباید به آنها اعتماد کنید. اگر در مورد قوانین حقوقی ، مشاوره پزشکی ، سیاست های مسافرتی یا هر چیز حساس به زمان سؤال می کنید ، بهتر است در جای دیگر بررسی کنید.

این ابزارها برای طوفان مغزی یا درک اساسی از چیزی ناآشنا عالی هستند. اما آنها جایگزینی برای راهنمایی های متخصص نیستند ، و رفتار با آنها مانند یک نفر می تواند شما را به سرعت به دردسر بیندازد.