به دنبال بررسی اینکه آیا چیزی توسط هوش مصنوعی ایجاد شده است؟ آشکارسازها اغلب کار نمی کنند و این برای امنیت شما خبر بدی است.

هوش مصنوعی (AI) خواه ناخواه کل بخشهای جامعه ما را متحول میکند و این شامل شبکه جهانی وب نیز میشود.

با نرمافزاری مانند ChatGPT که برای هر کسی که به اینترنت متصل است، در دسترس است، جدا کردن محتوای تولید شده توسط هوش مصنوعی از محتوای ایجاد شده توسط یک انسان به طور فزایندهای دشوار میشود. خوب است که ما آشکارسازهای محتوای هوش مصنوعی داریم، درست است؟

آیا آشکارسازهای محتوای هوش مصنوعی کار می کنند؟

آشکارسازهای محتوای هوش مصنوعی ابزارهای تخصصی هستند که تعیین می کنند چیزی توسط یک برنامه کامپیوتری نوشته شده است یا یک انسان. اگر فقط کلمات «ردیاب محتوای AI» را در گوگل جستجو کنید، خواهید دید که دهها آشکارساز وجود دارد که همه ادعا میکنند میتوانند به طور قابل اعتمادی بین متن انسانی و غیرانسانی تمایز قائل شوند.

روش کار آنها نسبتاً ساده است: شما یک قطعه نوشته را چسبانده اید و ابزار به شما می گوید که آیا توسط هوش مصنوعی تولید شده است یا خیر. به عبارت فنی تر، با استفاده از ترکیبی از تکنیک های پردازش زبان طبیعی و الگوریتم های یادگیری ماشین، آشکارسازهای محتوای هوش مصنوعی به دنبال الگوها و قابلیت پیش بینی می گردند و بر اساس آن تماس برقرار می کنند.

این روی کاغذ عالی به نظر می رسد، اما اگر تا به حال از یک ابزار تشخیص هوش مصنوعی استفاده کرده باشید، به خوبی می دانید که به طور ملایم، آنها را می گذراند. آنها اغلب محتوای نوشته شده توسط انسان را به عنوان AI یا متنی که توسط انسان ایجاد شده است به عنوان AI تشخیص می دهند. در واقع، برخی به طرز شرم آور در کاری که قرار است انجام دهند بد هستند.

آشکارسازهای محتوای هوش مصنوعی چقدر دقیق هستند؟

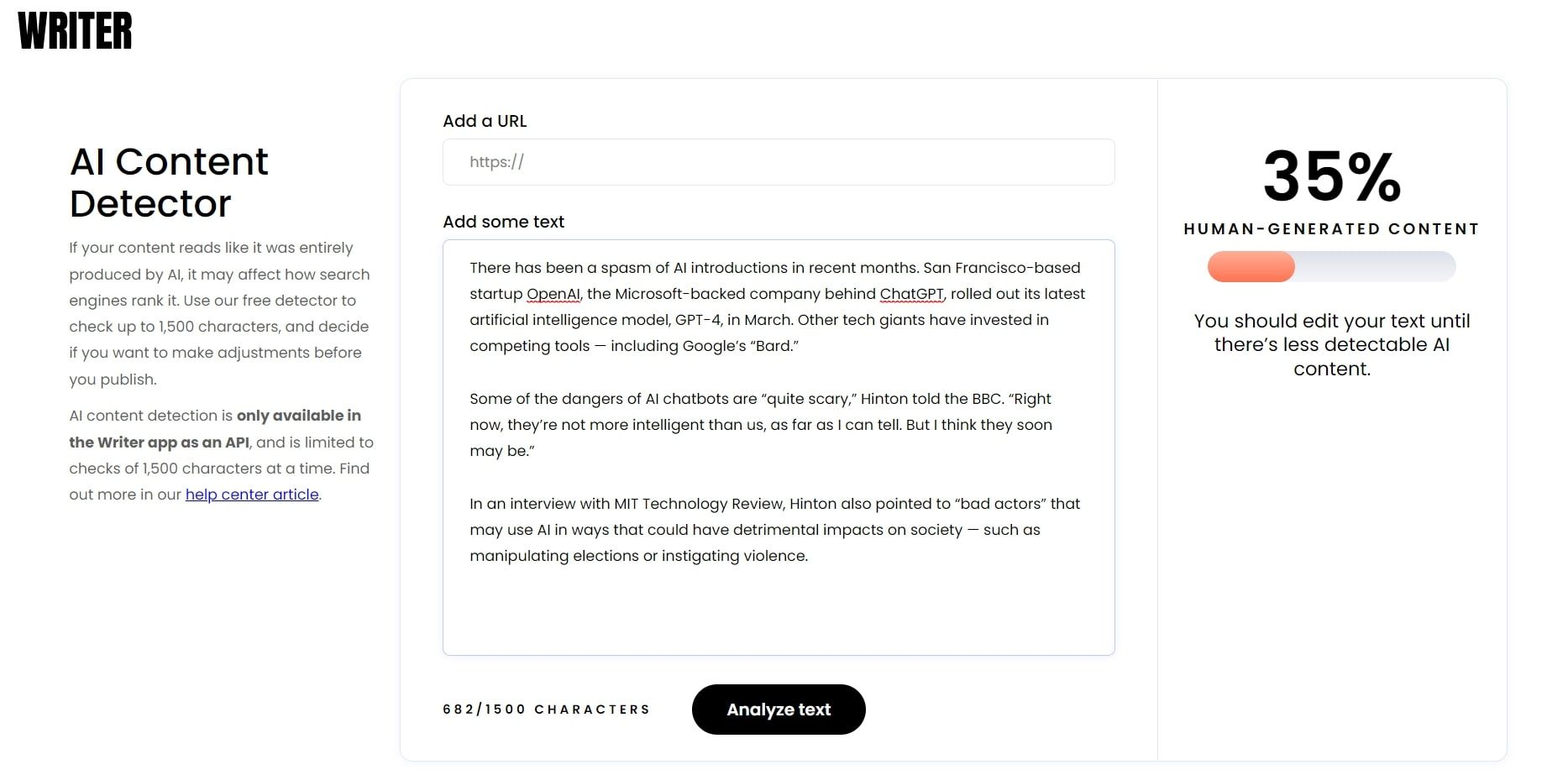

اگر در ایالات متحده هستید، اولین نتیجه جستجوی Google برای “شناساگر محتوای AI” writer.com است (قبلاً با نام قردوبا شناخته می شد؛ این یک پلت فرم محتوای هوش مصنوعی است که آشکارساز خود را نیز دارد). اما وقتی بخشی از این مقاله تصادفی آسوشیتدپرس را در ابزار قرار می دهید، ادعا می کند که شانس بسیار خوبی وجود دارد که توسط هوش مصنوعی تولید شده است.

بنابراین، writer.com اشتباه کرده است.

اگر بخواهیم منصف باشیم، دیگر آشکارسازهای محتوای هوش مصنوعی به سختی بهتر هستند. آنها نه تنها نتایج مثبت کاذب تولید می کنند، بلکه محتوای هوش مصنوعی را نیز به عنوان انسان علامت گذاری می کنند. و حتی اگر این کار را انجام نمیدهند، ایجاد تغییرات جزئی در متن ایجاد شده توسط هوش مصنوعی برای عبور با رنگهای مختلف کافی است.

در فوریه 2023، آرمین علیمردانی، مدرس دانشگاه ولونگونگ و اِما آ. جین، استادیار دانشگاه UNSW سیدنی، تعدادی از آشکارسازهای محتوای AI محبوب را آزمایش کردند و مشخص کردند که هیچ یک از آنها قابل اعتماد نیستند. علیمردانی و جین در تحلیل خود که در The Conversation منتشر شد، به این نتیجه رسیدند که این «مسابقه تسلیحاتی» هوش مصنوعی بین تولیدکنندههای متن و آشکارسازها، چالش مهمی در آینده بهویژه برای مربیان ایجاد خواهد کرد.

اما این فقط مربیان و معلمان نیستند که دلیلی برای نگرانی دارند: همه دارند. با فراگیر شدن متن تولید شده توسط هوش مصنوعی، تمایز قائل شدن بین آنچه “واقعی” است و آنچه نیست، یعنی در واقع تشخیص زمانی که چیزی توسط هوش مصنوعی نوشته شده است، دشوارتر می شود. این امر تقریباً بر تمام صنایع و حوزه های جامعه، حتی روابط شخصی، تأثیر زیادی خواهد داشت.

پیامدهای هوش مصنوعی برای امنیت سایبری و حریم خصوصی

این واقعیت که مکانیسم های قابل اعتمادی برای تعیین اینکه آیا چیزی توسط نرم افزار ایجاد شده است یا یک انسان وجود ندارد، پیامدهای جدی برای امنیت سایبری و حریم خصوصی دارد.

عوامل تهدید در حال حاضر از ChatGPT برای نوشتن بدافزار، تولید ایمیل های فیشینگ، نوشتن هرزنامه، ایجاد سایت های کلاهبرداری و موارد دیگر استفاده می کنند. و در حالی که راه هایی برای دفاع در برابر آن وجود دارد، مطمئناً نگران کننده است که هیچ نرم افزاری وجود ندارد که بتواند به طور قابل اعتمادی بین محتوای ارگانیک و ربات تمایز قائل شود.

اخبار جعلی نیز در حال حاضر یک مشکل بزرگ است. با هوش مصنوعی مولد در تصویر، عوامل اطلاعات نادرست میتوانند عملیات خود را به شیوهای بیسابقه مقیاسبندی کنند. در همین حال، یک فرد معمولی راهی ندارد که بداند چیزی را که آنلاین می خواند توسط نرم افزار ایجاد شده است یا یک انسان.

حریم خصوصی یک موضوع کاملا متفاوت است. برای مثال ChatGPT را در نظر بگیرید. قبل از راه اندازی، بیش از 300 میلیارد کلمه تغذیه می شد. این محتوا از کتابها، پستهای وبلاگ و انجمن، مقالات و رسانههای اجتماعی برداشته شده است. بدون رضایت کسی و با بیتوجهی ظاهراً کامل به حفظ حریم خصوصی و حق چاپ جمعآوری شد.

سپس مسئله مثبت کاذب نیز وجود دارد. اگر محتوا به اشتباه بهعنوان تولید شده توسط هوش مصنوعی پرچمگذاری میشود، آیا این نمیتواند منجر به سانسور شود، که به هر حال مسئلهای بزرگ است؟ ناگفته نماند آسیبی که متهم به استفاده از متن ایجاد شده با هوش مصنوعی می تواند به شهرت فرد، چه آنلاین و چه در زندگی واقعی، وارد کند.

اگر واقعاً یک مسابقه تسلیحاتی بین هوش مصنوعی مولد و آشکارسازهای محتوا وجود داشته باشد، اولی برنده است. بدتر از آن، به نظر می رسد هیچ راه حلی وجود ندارد. همه ما محصولات نیمه پخته خود را داریم که حتی در نیمی از زمان کار نمی کنند، یا می توان آنها را به راحتی فریب داد.

نحوه تشخیص محتوای هوش مصنوعی: راه حل های بالقوه

اینکه ما در حال حاضر به نظر نمیرسد پاسخ واقعی برای این مشکل داشته باشیم به این معنی نیست که در آینده پاسخی نخواهیم داشت. در واقع، در حال حاضر چندین پیشنهاد جدی وجود دارد که می تواند کارساز باشد. واترمارک یکی است.

وقتی صحبت از هوش مصنوعی و مدلهای زبان عمیق به میان میآید، واترمارکینگ به تعبیه یک نوع کد مخفی در متن تولید شده توسط هوش مصنوعی (مانند الگوی کلمه، سبک نقطهگذاری) اشاره دارد. چنین واترمارکی با چشم غیرمسلح نامرئی خواهد بود و در نتیجه حذف آن تقریبا غیرممکن است، اما نرم افزارهای تخصصی قادر به تشخیص آن خواهند بود.

در واقع، در سال 2022، محققان دانشگاه مریلند یک روش جدید علامت گذاری را برای شبکه های عصبی مصنوعی توسعه دادند. محقق اصلی تام گلدشتاین در آن زمان گفت که تیم او موفق شده است “از نظر ریاضی ثابت کند” که واترمارک آنها نمی تواند به طور کامل حذف شود.

در حال حاضر، کاری که یک فرد معمولی می تواند انجام دهد، تکیه بر غرایز و عقل سلیم خود است. اگر چیزی در مورد محتوایی که میخوانید وجود داشته باشد – اگر غیرطبیعی، تکراری، غیرقابل تصور و پیش پا افتاده باشد – ممکن است توسط نرمافزار ایجاد شده باشد. البته، شما همچنین باید هر گونه اطلاعاتی را که آنلاین می بینید تأیید کنید، منبع را دوباره بررسی کنید و از وب سایت های مخدوش دوری کنید.

انقلاب هوش مصنوعی در جریان است

برخی استدلال می کنند که انقلاب صنعتی پنجم در حال حاضر فرا رسیده است، زیرا هوش مصنوعی در مرکز آنچه که به عنوان همگرایی دیجیتال و فیزیکی توصیف می شود، قرار می گیرد. چه واقعاً چنین باشد یا نه، تنها کاری که میتوانیم انجام دهیم این است که خود را وفق دهیم.

خبر خوب این است که صنعت امنیت سایبری در حال تطبیق با این واقعیت جدید است و استراتژیهای دفاعی جدیدی را با هوش مصنوعی و یادگیری ماشینی در خط مقدم پیادهسازی میکند.