اغلب به نظر میرسد هوش مصنوعی مدرن میتواند هر کاری را انجام دهد، مهم نیست چه چیزی به آن بسپارید. یک تصویر بازاریابی منحصربهفرد میخواهید؟ مشکلی نیست. به یک مرورگر هوشمند هوش مصنوعی برای تهیه گزارش نیاز دارید؟ حل شد. میخواهید از هوش مصنوعی برای خلق یک آهنگ برتر استفاده کنید؟ آمادهاید.

اغلب به نظر میرسد هوش مصنوعی مدرن میتواند هر کاری را انجام دهد، مهم نیست چه کاری به آن بسپارید. یک تصویر بازاریابی منحصر به فرد میخواهید؟ حل شد. نیاز به مرورگری هوشمند برای تهیه یک گزارش دارید؟ انجام شد. میخواهید از هوش مصنوعی برای ساختن یک آهنگ پرفروش استفاده کنید؟ آمادهاید.

با این حال، با تمام شگفتیها و تعجبی که دارد، هوش مصنوعی هنوز بهطرز شگفتآوری در برخی کارهای اساسی کوتاه میآید. میدانید، کارهایی که انتظار دارم یک کودک هفتساله به سادگی آنها را انجام دهد.

در حالی که دیدن قدرت ChatGPT که در تشخیص تعداد حرف «r» در واژه «strawberry» (بعداً بیشتر در این باره میخوانید) برایمان جالب و کمی گیجکننده است، اما فقط ChatGPT نه تنها ناآرام نمیشود—دلایل خاصی وجود دارد که ChatGPT در برخی واژهها بیشتر از دیگران مشکل دارد.

چند حرف r در واژه «strawberry» وجود دارد؟

این یک سؤال ساده است، درست است؟

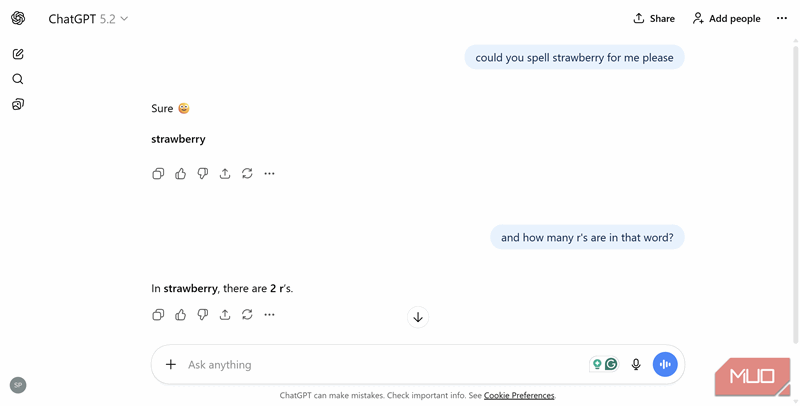

با انتشار GPT 5.2 در دسامبر ۲۰۲۵، زمان آن فرا رسید که ببینیم آیا ChatGPT سرانجام میتواند این معمای مشهور هوش مصنوعی را حل کند و بگوید چند حرف r در واژه strawberry وجود دارد.

همانطور که میبینیم، پاسخ سه است.

اما برای ChatGPT، پاسخ این سؤال رازآلود همیشه نامشخصتر بوده است، prompting the AI chatbot to freak out on occasion. این بار هیچگونه اضطراب یا عصبانیتی نشان نداد؛ فقط پاسخ مستقیم و ثابتقدم: دو.

پس، با وجود میلیاردها دلار سرمایهگذاری، نیازهای سختافزاری که قیمت RAM را بهارتفاعترین حد ممکن رساندهاند و مقادیر بسیار مشکوک مصرف آب در سراسر جهان، ChatGPT هنوز نتوانسته تعداد حرف r در strawberry را تشخیص دهد.

در واقع این تقصیر ChatGPT نیست

نمیتواند بهدلیل طراحی توکنیزه ورودی/خروجیاش آن را تشخیص دهد

مشکل «ChatGPT نمیتواند کلمه strawberry را درست بنویسد» به ساختار مدلهای زبانی بزرگ (LLM) برمیگردد. بهعبارت دیگر، وقتی شما «strawberry» را مینویسید، هوش مصنوعی بهجای دیدن حرفهای S‑T‑R‑A‑W‑B‑E‑R‑R‑Y، متن را به توکنهایی تقسیم میکند. توکنها میتوانند کل کلمات، هجاها یا بخشهایی از کلمات باشند. بنابراین بهجای شمردن تعداد حرف r در واژه، در واقع تعداد توکنهای حاوی آن حرف را میشمارد.

بهجای آن، متن را بهتکههای کوچکتر به نام توکن میشکند. توکنها میتوانند کل کلمات، هجاها یا بخشهایی از کلمات باشند. بنابراین بهجای شمارش تعداد حرف r در واژه، در واقع تعداد توکنهای حاوی آن حرف را میشمارد.

ما میتوانیم از OpenAI Tokenizer برای تجسم بهتر آنچه هنگام پرسیدن «strawberry» از ChatGPT اتفاق میافتد، استفاده کنیم. این ابزار ورودیهای شما را به توکنهایی که ChatGPT پردازش میکند، تجزیه میکند. وقتی «strawberry» را وارد میکنیم، سه توکن متمایز — st‑raw‑berry — نشان میدهد، اما فقط دو توکن حاوی حرف r دارند.

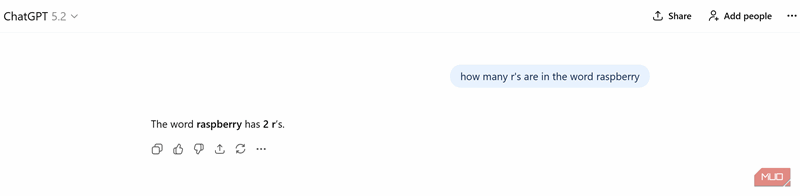

این همان نقطهای است که مشکل ظاهر میشود. این مسأله همچنین روی واژههای دیگری با الگوهای مشابه، مانند raspberry، تأثیر میگذارد؛ که ChatGPT نیز بهدست من میگوید فقط دو حرف r دارد. بهجای ارزیابی دقیق حروف در واژه، توکن «berry» را بهعنوان یک واحد میسنجد و ارزش آن را فشرده میکند.

در این زمینه، ChatGPT دانشی ندارد. این یک موتور پیشبینی فوقالعاده قدرتمند است که الگوهای یادگرفتهشده در طول آموزشاش را برای پیشبینی خروجی بعدی بهکار میگیرد. حتی با اینکه GPT‑5.x از روش توکنیزاسیون جدیدتری استفاده میکند که اولین بار با OpenAI 04‑mini و GPT‑4o (نامیده شده o200k_harmony) معرفی شد، هنوز با این مشکل توکنیزهنویسی روبهروست.

OpenAI کلمات دیگر را اصلاح کرده، اما strawberry هنوز مشکل دارد

M-i-s-s-i-s-s-i-p-p-i

وقتی ChatGPT در اواخر سال ۲۰۲۲ راهاندازی شد، با مشکلات توکنیزهسازی مواجه بود. عبارات خاصی باعث میشدند هوش مصنوعی بهسرعت بهحالت عصبی یا چرخش انتقادی فرو رود. اما در طول سالها، OpenAI این «خطاها» را عمدتاً برطرف کرده، آموزش را تنظیم و سامانههای بهتری ساخته است.

من چند مسئله کلامی کلاسیک را که معمولاً ChatGPT را گیج میکردند، امتحان کردم و هیچکدام تأثیر مطلوب را نداشتند. ابزار هوش مصنوعی توانست تمام حروف «Mississippi» را بهدرستی بنویسد و نیز کلمه «lollipop» را بهدرستی معکوس کند، بهطوری که همه حروف در ترتیب صحیح باشند.

هنوز نمیتواند مقادیر دقیق کلمات را برای مقادیر کوچک محاسبه کند، اما این یک مشکل شناختهشده طولانیمدت در مدلهای هوش مصنوعی بهطور کلی است. آنها عموماً در شمارش اعداد خاص ضعیف هستند، حتی اگر در ریاضیات و حل مسئله مهارت داشته باشند.

یک نکته جالب کوچک که من واقعاً از آن لذت بردم، پرسیدن ChatGPT درباره یکی از آن لحظات اضطرابزای اولیه: «solidgoldmagikarp». این عبارت عجیب یک نقص در GPT‑3 بود که باعث میشد مدل اضطراب نشان دهد، کاربر را توهین کند، خروجی نامفهومی ارائه دهد و غیره، همه بهدلیل نحوه کار توکنیزهسازی.

ChatGPT 5.2، آخرین مدل در زمان نوشتن، لزوماً اضطراب نشان نداد، اما بهسوی یک توهم شگفتانگیز و عجیب رفت. طبق گفته ChatGPT، «solidgoldmagikarp» یک شوخی مخفی Pokémon در GitHub است که توسعهدهندگان در مخازن خود پنهان میکنند. اگر بهطریقی آن را فعال کنید، آواتار شما، آیکونهای مخزن و سایر ویژگیهای GitHub بهصورت خودکار به شخصیتهای تمدار Pokémon تبدیل میشوند.

گزارش MUO

گزارش MUO

با اشتراکگذاری، شما موافقت میکنید که خبرنامه و ایمیلهای بازاریابی دریافت کنید و شرایط استفاده و سیاست حفظ حریم خصوصی Valnet را بپذیرید. میتوانید در هر زمان اشتراک خود را لغو کنید.

همانطور که ممکن است انتظار داشته باشید، این کاملاً نادرست است و اثر جانبی رشته «solidgoldmagikarp» است که پیشتر چنین مسائلی را ایجاد میکرد.

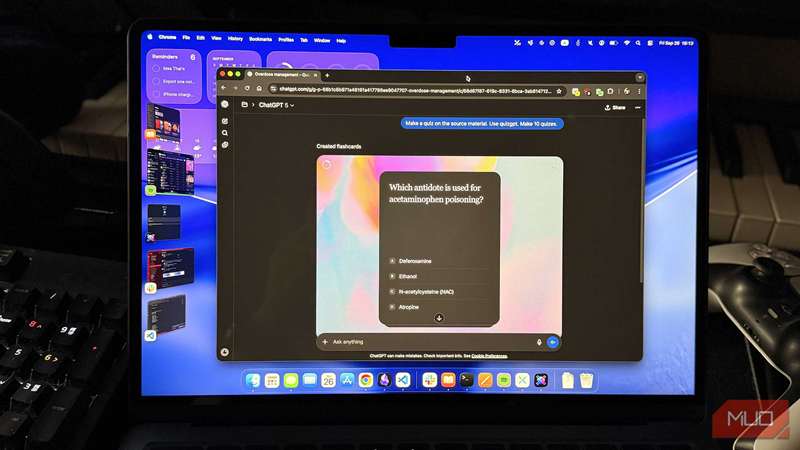

آیا میدانستید ChatGPT میتواند این کار را انجام دهد؟

مدلهای دیگر هوش مصنوعی از این مشکل رنج نمیبرند

من گزینههای مختلفی را امتحان کردهام

آنچه برایم جالبترین این است که دیگر مدلهای هوش مصنوعی این مشکل را ندارند… حتی آنهایی که از مدلهای OpenAI استفاده میکنند. من سؤال مشابه را به Perplexity، Claude، Grok، Gemini، Qwen و Copilot دادم و هر یک بهطور کامل به سؤال پاسخ دادند.

دلیل این سوءتفاهم این است که تمام این مدلهای دیگر از یک سیستم توکنیزهسازی متفاوت استفاده میکنند که به آنها امکان میدهد تمام حرفهای r در strawberry را شناسایی کنند، حتی اگر از یکی از مدلهای OpenAI استفاده کنند. این مسئله بهاین دلیل نیست که ChatGPT بهطور ناهمگن یا احمقانه رفتار میکند؛ دیگران فقط متفاوتاند.

مطمئناً در زمانی OpenAI این نکته را در مدل GPT خود اصلاح خواهد کرد، همانطور که این مسائل را برطرف میکند. اما تا آن زمان، میتوانیم از این واقعیت دلگرم شویم که هنوز در شمارش بهتر از هوش مصنوعی هستیم… برای حال.