آیا واقعاً می توان از هنر اصیل در برابر هوش مصنوعی محافظت کرد؟ خلاق ها به طور فزاینده ای ناتوان به نظر می رسند.

ابزارهای مولد هوش مصنوعی مانند Midjourney و Stable Diffusion در حال تولید تصاویر بصری متقاعدکنندهای هستند. با این حال، آنها برای تولید محتوای خود به پایگاههای اطلاعاتی وسیعی از کار خلاقان متکی هستند. در این مرحله، ممکن است تعجب کنید که آیا راهی برای محافظت از کار شما در برابر ابزارهای هوش مصنوعی وجود دارد و پاسخ این است: پیچیده است.

ابزارهای هوش مصنوعی مولد چگونه از کار هنرمندان استفاده می کنند؟

ابزارهای هوش مصنوعی مولد از مدل های یادگیری ماشینی استفاده می کنند که برای انجام اقدامات با استفاده از مجموعه داده های بزرگ آموزش دیده اند. فرض کنید در مورد یک تولید کننده تصویر هوش مصنوعی مانند Midjourney صحبت می کنیم. در این مورد، مجموعه دادههای مورد استفاده برای آموزش شامل میلیاردها جفت تصویر و متن است – از آثار هنرمندان افسانهای مانند پیکاسو گرفته تا خلاقان حرفهای و آماتور.

مولدهای هنر هوش مصنوعی از این جفتهای رسانه-متن برای تولید محتوای بصری در پاسخ به درخواستهای متنی کاربر استفاده میکنند. اساساً، آنها از آثار هنرمندان موجود استفاده میکنند و الگوها را با جفتهای متنی (پستهای اجتماعی، زیرنویسها، متن جایگزین، و غیره) مطابقت میدهند تا کاربران بتوانند تصاویر جدیدی را از پیامهایی مانند «آسمان پرستاره شب به سبک ونسان ون گوگ» یا «صحنهای نئو نوآر از یک کارآگاه در حال نوشیدن ویسکی در شهر 1950» تولید کنند.

چرا بسیاری از هنرمندان ناراحت هستند؟

بزرگترین شکایت از خلاقان این است که ابزارهای هوش مصنوعی مولد بدون اجازه از کار خود استفاده می کنند. آنها به سادگی از کار خود برای آموزش الگوریتم ها نیز استفاده نمی کنند.

بحث بازاریابی در مورد هوش مصنوعی مولد نشان می دهد که این ابزارها محتوای منحصر به فردی ایجاد می کنند، اما اینطور نیست. کاری که آنها واقعاً انجام میدهند این است که دادهها را از چندین قطعه هنری ترکیب میکنند و آنها را با هم ترکیب میکنند تا چیزی را تولید کنند که با درخواست کاربر مطابقت داشته باشد.

اصطلاح نسل هوش مصنوعی به خودی خود گمراه کننده است. تکثیر هوش مصنوعی دقیق تر خواهد بود و ترفند این ابزارها این است که حجم زیادی از آثار هنری را تکرار می کنند و آنها را با هم ترکیب می کنند.

ابزارهای هوش مصنوعی مولد برای جایگزینی خلاقان طراحی شده اند – و آنها این کار را با استفاده از آثار هنری خود انجام می دهند. و، گویی این به اندازه کافی بد نیست، اکثر ابزارهای هوش مصنوعی همه این کارها را بدون درخواست اجازه، ارائه هرگونه غرامت یا حتی اعتبار دادن به سازندگان اصلی انجام می دهند.

آیا می توانید دسترسی ابزارهای هوش مصنوعی مولد به آثار هنری خود را متوقف کنید؟

متأسفانه، تنها راه برای جلوگیری از دسترسی ابزارهای هوش مصنوعی به هر یک از محتوای شما این است که چیزی به صورت آنلاین منتشر نکنید. ممکن است افراطی به نظر برسد، اما این واقعیت است. مطمئناً، میتوانید از فایل robots.txt در وبسایت خود استفاده کنید تا ابزارهای هوش مصنوعی را از خراشیدن وبسایت خود جلوگیری کنید، یا با انصراف از مجموعه دادههای آموزشی، از تصاویر خود در برابر هوش مصنوعی محافظت کنید، اما این روشها محدودیتهای متعددی دارند.

اولاً، دستورات موجود در فایل robots.txt توصیهای هستند، به این معنی که سایتها هیچ تعهد قانونی برای پایبندی ندارند. در مرحله دوم، شما باید شرکتی مانند گوگل را از خزیدن در وب سایت خود مسدود کنید، که اساساً خودکشی SEO است. و در نهایت، فایل robots.txt فقط به شما کنترل (محدود) بر دسترسی به وب سایت شما می دهد، هیچ کاری برای محافظت از محتوایی که در جاهای دیگر منتشر می کنید: رسانه های اجتماعی، سرویس های ابری و غیره انجام نمی دهد.

متأسفانه برای خلاقان، چشم انداز قبل از اینکه بهتر شود بدتر می شود.

سیاست حفظ حریم خصوصی گوگل می تواند به این معنی باشد که از تمام محتوای آنلاین برای آموزش الگوریتم های هوش مصنوعی خود استفاده می کند.

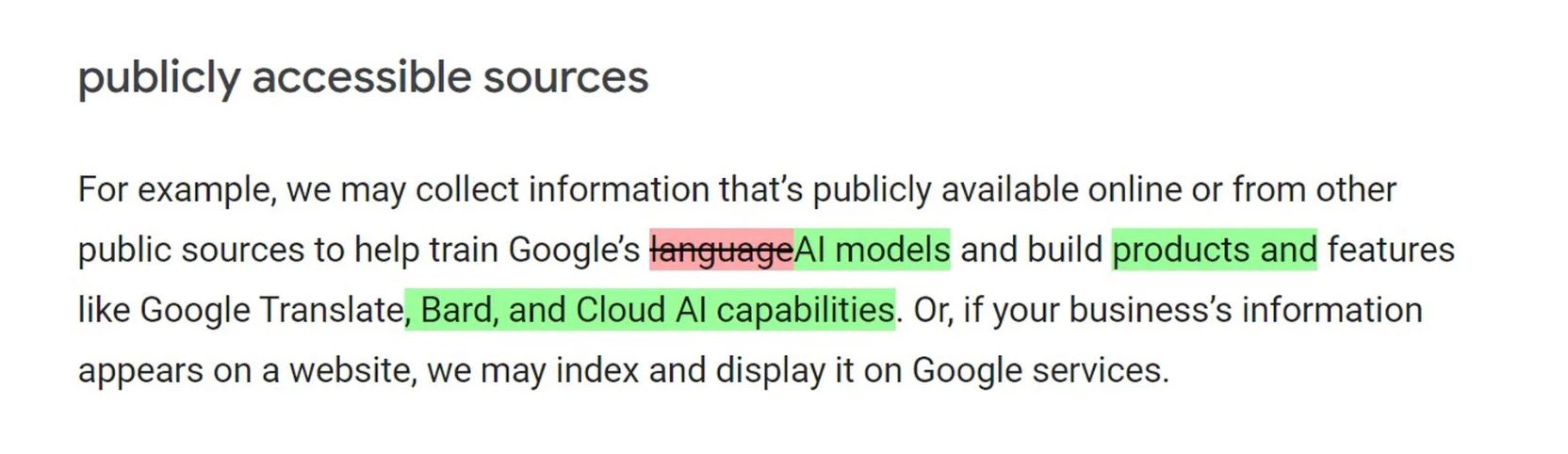

در ژوئیه 2023، گوگل سیاست حفظ حریم خصوصی خود را به روز کرد و گفت که از محتوای آنلاین برای آموزش سیستم های هوش مصنوعی خود از جمله براد، گوگل ترنسلیت و سایرین استفاده خواهد کرد. گوگل از عبارت «منابع در دسترس عموم» استفاده می کند. در اینجا نقل قولی است که برخی از زنگ های هشدار را پس از به روز رسانی به صدا درآورد:

برای مثال، ما ممکن است اطلاعاتی را جمعآوری کنیم که به صورت آنلاین یا از منابع عمومی دیگر در دسترس است تا به آموزش مدلهای هوش مصنوعی Google و ساخت محصولات و ویژگیهایی مانند قابلیتهای Google Translate، Bard و Cloud کمک کنیم.» – سیاست حفظ حریم خصوصی Google

به عبارت دیگر، گوگل اکنون میگوید که هر چیزی که به صورت آنلاین منتشر میکنید قابل قبول است. حداقل، Google با برجسته کردن جدیدترین تغییرات، مقایسه بهروزرسانیها با خطمشی رازداری خود را آسان میکند:

همانطور که می بینید، تغییرات در جمله بندی بسیار ظریف است، اما پیامدهای آن قابل توجه است. پیش از این، کارکردهای اصلی مدلهای زبان گوگل، تفسیر پرسشهای جستجو و ترجمه متن به زبانهای دیگر بود.

اکنون، این شرکت میگوید ممکن است از همه منابع در دسترس عموم برای آموزش مجموعه کامل مدلهای هوش مصنوعی خود استفاده کند. این شامل سیستم هوش مصنوعی مولد آن، Bard، میشود و فراتر از مدلهای زبانی گسترش مییابد و همه ابزارها/ویژگیهای هوش مصنوعی گوگل را در بر میگیرد – واضحترین مثال تولید تصویر است.

شبکه های اجتماعی می توانند از هر محتوایی که در پلتفرم های خود منتشر می کنید استفاده کنند

متا همچنین به همه چیزهایی که در فیس بوک، اینستاگرام و Threads منتشر می شود دسترسی نامحدود دارد. اگر قوانین و مقررات را بخوانید، این روش استاندارد برای پلتفرم های اجتماعی است. به محض اینکه شما چیزی را در یک شبکه اجتماعی آپلود می کنید، آنها حق استفاده و استفاده مجدد از آن را به هر شکلی که می خواهند دارند.

بسیاری از کاربران اجتماعی شرکت هایی را یافته اند که از تصاویر خود در تبلیغات بدون اجازه استفاده می کنند، از جمله افراد خلاق. متأسفانه، اگر آن شرکت شبکه اجتماعی باشد که تصویر را در آن آپلود کردهاید، شرکت مادر شبکه یا برند دیگری متعلق به همان شرکت مادر، شانس شما را ندارید.

برای اکثر مردم، شانس پلتفرمی مانند اینستاگرام از یکی از تصاویر خود برای یک کمپین تبلیغاتی بسیار کم است. با این حال، متا تقریباً مطمئناً از تصاویر، ویدیوها و پست های شما برای آموزش الگوریتم های هوش مصنوعی خود استفاده می کند.

سرویسهایی مانند Adobe ممکن است به کار شما برای آموزش الگوریتمهایشان دسترسی داشته باشند و از آنها استفاده کنند

در ژانویه 2023، Adobe برای به روز رسانی T&Cهای خود کمی داغ شد. به نظر میرسد این زبان نشان میدهد که ادوبی میتواند از تصاویر آپلود شده در سرویسهای ابری خود توسط عکاسان برای آموزش الگوریتمهای هوش مصنوعی خود استفاده کند.

عبارت مشخص به شرح زیر بود:

“Adobe ممکن است محتوای شما را با استفاده از تکنیک هایی مانند یادگیری ماشینی (مثلاً برای تشخیص الگو) برای توسعه و بهبود محصولات و خدمات خود تجزیه و تحلیل کند.”

بدتر از همه، Adobe به طور خودکار کاربران را به این سیستم تجزیه و تحلیل محتوا انتخاب می کرد، به این معنی که آنها باید به صورت دستی آن را در تنظیمات حساب خود خاموش می کردند. قابل درک است که خلاقان خیلی مهربانانه واکنش نشان ندادند و Adobe با پاسخ ندادن در ابتدا به انتقادات شعله های آتش را شعله ور کرد.

هفتهها بعد، ادوبی اعلام کرد که از هیچ داده مشتری برای آموزش ابزارهای هوش مصنوعی تولیدی آن استفاده نمیشود. این شرکت این حادثه را یک زنگ بیدارباش خواند و متعهد شد که هر گونه سردرگمی را با مشخص کردن متن سیاست خود برطرف کند.

در هر صورت، این واقعیت باقی میماند که اگر ادوبی بخواهد از دادههای مشتریان برای آموزش سیستمهای هوش مصنوعی خود استفاده کند، هیچکس نمیتواند در مورد آن انجام دهد – غیر از تحریم. در همان زمان، Adobe داده های خود را برای ابزارهایی مانند Generative Fill از جایی دریافت می کند، بنابراین از کارهای هنرمندان به هر شکلی استفاده می کند.

شرکتهای فناوری در حال حاضر تقریباً نامحدود به دادههای شما دسترسی دارند

همانطور که اوضاع پیش میرود، غولهای فناوری مانند گوگل و متا تقریباً نامحدود به دادههای خلاقان دسترسی دارند. بررسی دقیق در مورد استفاده آنها از داده های کاربر تقریباً به قدمت اینترنت است، با این حال مقررات حفظ حریم خصوصی همچنان در حال پیگیری است.

اجرای دستورالعمل های حفظ حریم خصوصی GDPR از اتحادیه اروپا تا سال 2018 طول کشید و آنها برای محافظت از داده های کاربران کار چندانی انجام نداده اند.

هوش مصنوعی مولد یک میدان مین جدید است که تقریباً هیچ مقرراتی برای محدود کردن اقدامات شرکت های فناوری در این فضا وجود ندارد. در حال حاضر، شرکتهایی مانند Google و OpenAI میتوانند تقریباً هر کاری را که میخواهند با دادههای ما انجام دهند، و این به این زودیها تغییر نخواهد کرد.

در نهایت، برای محافظت از هنرمندان در برابر هوش مصنوعی، شکایتها و مقررات لازم است

تا زمانی که هوش مصنوعی مولد و دسترسی آن به دادههای کاربر تنظیم نشود، خلاقان تقریباً قادر به متوقف کردن این فناوری نیستند. محتمل ترین سناریو تغییرات در قوانین حق چاپ یا به طور بالقوه، حفاظت از داده های جدید مربوط به مالکیت خلاق است. در هر صورت، زمان زیادی طول می کشد تا شاهد معرفی و اجرای مقررات جدید باشیم.

خط نقره ای برای خلاقان این است که شکایت های حقوقی علیه هوش مصنوعی مولد به سرعت در حال انباشته شدن است و این می تواند پاسخ قانونی را تسریع کند. خبر بد این است که برخی از شرکتهای فناوری درگیر دارای بودجه قانونی هستند تا این پروندهها را از زمانبرترین راههای رسیدگی قانونی بکشانند.

در این میان، سؤالات اخلاقی بر سر نسل هنر هوش مصنوعی باقی خواهند ماند.